Daten sind heute das zentrale Betriebskapital der Industrie. Sie steuern Produktionsprozesse, ermöglichen vorausschauende Wartung, verkürzen Entwicklungszeiten und eröffnen mit Künstlicher Intelligenz neue Geschäftsmodelle. Ob im eigenen Werk, in externen Rechenzentren oder in der Cloud: Die digitale Leistungsfähigkeit von Unternehmen beruht auf einer zuverlässigen und leistungsstarken Recheninfrastruktur.

Mit jedem digitalen Zwilling und jeder Echtzeitanalyse wächst der Bedarf an Rechenleistung weiter. Was digital nach Effizienz klingt, hat jedoch eine klare physikalische Konsequenz: Rechenleistung benötigt Energie, und Energie wird zu Wärme. Moderne Hochleistungsprozessoren bündeln enorme Leistung auf kleinem Raum. Dadurch steigt die thermische Belastung sowie der Wasserverbrauch in Rechenzentren kontinuierlich an. Nach Angaben der Internationalen Energieagentur lag der weltweite Stromverbrauch von Rechenzentren im Jahr 2024 bei rund 415 TWh. Das entspricht etwa 1,5 Prozent des globalen Strombedarfs – Tendenz steigend. Besonders Hochleistungs-Grafikprozessoren (GPU-Chips), die für KI-Anwendungen unverzichtbar sind, verbrauchen deutlich mehr Strom als klassische Prozessorarchitekturen (CPU). Mit der steigenden Rechendichte und Leistungsfähigkeit wächst damit nicht nur der Energiebedarf, sondern zwangsläufig auch die thermische Belastung der Infrastruktur. In vielen Rechenzentren entfällt inzwischen bis zu 40 Prozent des gesamten Strombedarfs auf die Kühlung.

Damit rückt eine neue Schlüsselfrage in den Mittelpunkt der digitalen Transformation: Wie lassen sich die entstehenden Wärmeströme so präzise erfassen, steuern und abtransportieren, dass Effizienz, Betriebssicherheit und Nachhaltigkeit gleichermaßen gewährleistet bleiben?

Paradigmenwechsel bringt Herausforderungen

Über Jahrzehnte war Luft das zentrale Kühlmedium in Rechenzentren. Mit den heutigen Leistungsdichten stößt dieses Prinzip jedoch zunehmend an seine physikalischen Grenzen. Vor allem Systeme mit Hochleistungs-Grafikprozessoren erzeugen deutlich höhere Wärmemengen, die sich über Luft allein kaum noch effizient abführen lassen. Flüssige Kühlmedien bieten hier Vorteile: Sie besitzen eine wesentlich höhere Wärmekapazität und können Hitze direkt an den entstehenden Hotspots aufnehmen – etwa an GPU-Modulen oder in dicht bestückten Serverracks. Dadurch lassen sich höhere Leistungsdichten realisieren und Temperaturen präziser kontrollieren. Für den wirtschaftlichen Betrieb moderner, grafikprozessorbasierter Rechensysteme ist Flüssigkeitskühlung deshalb zunehmend Voraussetzung.

Mit der Umstellung steigt jedoch die Komplexität. Mehrere Kühlkreisläufe, variable Volumenströme und unterschiedliche Temperaturzonen müssen stabil aufeinander abgestimmt werden. Bereits geringe Abweichungen im Durchfluss oder in der Temperaturdifferenz zwischen Vor- und Rücklauf können die Effizienz deutlich mindern oder kritische Zustände verursachen. Gleichzeitig stellt die Sensorik neue Anforderungen: Messstellen müssen so platziert sein, dass sie thermisch aussagekräftig sind und dennoch gewartet werden können, ohne den Betrieb zu beeinträchtigen. Das Kühlmedium selbst kann Sensoren langfristig durch Korrosion oder Ablagerungen beeinflussen, weshalb es auf die Materialauswahl und Messprinzip ankommt. Zudem sind schnelle Ansprechzeiten erforderlich, um dynamische Lastwechsel zuverlässig zu erfassen. Besonders einfache Zweileiter-Widerstandsthermometer (Resistance Temperature Detector, RTD), wie sie häufig in Heizungs-, Lüftungs- und Klimaanlagen eingesetzt werden, können durch Leitungswiderstände Messfehler verursachen – insbesondere bei größeren Entfernungen. In einer Umgebung, in der Ausfälle mit erheblichen wirtschaftlichen Schäden verbunden sind, ist daher eine präzise und kontinuierliche Echtzeitüberwachung unverzichtbar.

Messtechnik wird Teil der Infrastruktur

Mit der steigenden technischen Komplexität wächst auch die strategische Bedeutung der Messtechnik. Sie ist nicht nur Grundlage für einen stabilen Betrieb, sondern zunehmend auch regulatorische Voraussetzung. Das Energieeffizienzgesetz verlangt eine transparente Erfassung von Energieflüssen sowie die Nutzung entstehender Abwärme. Dafür müssen Durchfluss sowie Vor- und Rücklauftemperaturen präzise gemessen und mithilfe eines Energierechners zur tatsächlichen thermischen Leistung verrechnet werden. Erst diese Daten schaffen Klarheit über Kühlleistung und Energieverbrauch und ermöglichen es, Abwärme regelkonform etwa in ein Nah- oder Fernwärmenetz einzuspeisen. Eichfähige Messgeräte bilden dabei die Basis für belastbare Abrechnungen. Auch bestehende Anlagen lassen sich nachrüsten: Clamp-on-Lösungen für Temperatur- und Ultraschall-Durchflussmessungen erlauben eine Integration im laufenden Betrieb ohne Unterbrechung von kritischen Kühlkreisläufen.

Darüber hinaus ist Messtechnik ein zentraler Faktor für die Betriebssicherheit. Die kontinuierliche Überwachung von pH-Wert, Leitfähigkeit und Trübung der Kühlflüssigkeit ermöglicht es, Veränderungen der Medienqualität frühzeitig zu erkennen. So lassen sich Korrosion, Ablagerungen oder Materialabbau identifizieren, bevor empfindliche und kostenintensive Komponenten wie GPU-Chips oder Pumpensysteme Schaden nehmen. Ebenso wichtig ist die Qualität der Temperaturmessung selbst. Während in klassischen Heizungs-, Lüftungs- und Klimaanlagen häufig einfache Zweileiter-Widerstandsthermometer zum Einsatz kommen, können diese durch Leitungswiderstände Messfehler verursachen, insbesondere bei größeren Entfernungen. Drei- oder Vierleiter-RTD-Sensoren kompensieren diesen Einfluss beziehungsweise eliminieren ihn vollständig und gewährleisten dadurch langfristig stabile und reproduzierbare Messwerte. Eine höhere mittlere Betriebsdauer zwischen Ausfällen (Mean Time Between Failure, MTBF) erhöht zusätzlich die Verfügbarkeit der Systeme.

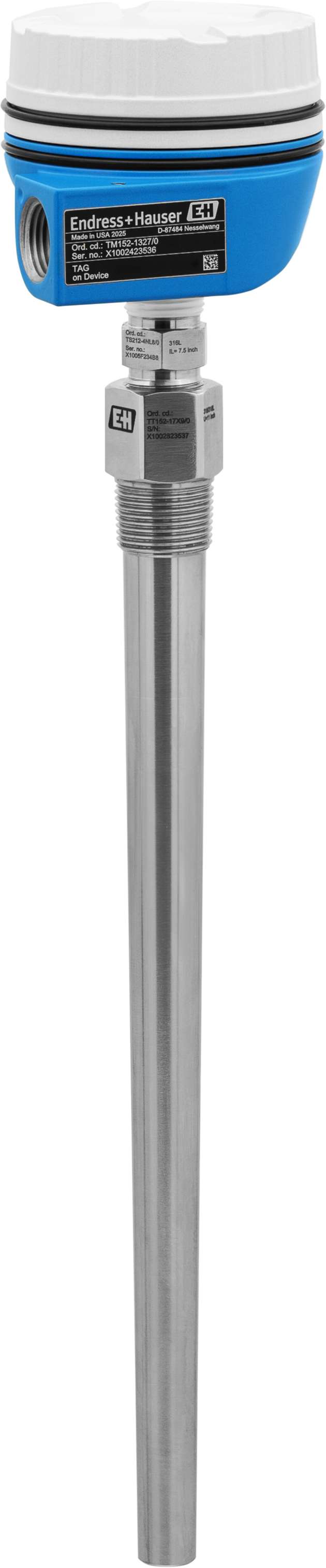

Für Flüssigkeitskühlsysteme in Rechenzentren braucht es jetzt vor allem eines: zuverlässige und wartungsfreundliche Messtechnik. Sensoren müssen dauerhaft präzise arbeiten und zugleich so ausgelegt sein, dass sie sich im laufenden Betrieb prüfen oder austauschen lassen. Hier bieten robuste Thermometer wie das iTHERM ModuLine TM152 oder TM151 von Endress+Hauser eine stabile Lösung. Dank eines speziellen Schnellverschlusses kann der Messeinsatz schnell gewartet oder kalibriert werden, ohne das gesamte System stillzulegen. In Verbindung mit einem Temperaturtransmitter lässt sich zudem ein zweiter Sensor integrieren. Fällt einer aus, übernimmt automatisch der andere. Das erhöht die Betriebssicherheit deutlich. Ergänzende Anzeigegeräte wie RIA14, RIA45 oder RIA15 machen die Temperaturwerte zentral sichtbar und helfen, Energieeinsatz und Kühlleistung im Blick zu behalten. In Kombination mit Durchflussmessungen lassen sich daraus auch die tatsächlich abgeführten Wärmemengen berechnen. Energierechner wie der EngyCal RH33 erfassen dafür Temperaturdifferenzen und Volumenströme und stellen die resultierende Wärmeleistung transparent dar. So wird Messtechnik zu einem festen Bestandteil eines effizienten und stabilen Rechenzentrumsbetriebs – nicht nur zur Kontrolle, sondern zur aktiven Sicherung von Verfügbarkeit und Energieeffizienz.

Digitale Wertschöpfung braucht thermische Verantwortung

Für Industrieunternehmen endet die Verantwortung nicht an der Schnittstelle zur Cloud oder zum Rechenzentrumsbetreiber. Wer Prozesse digitalisiert, Künstliche Intelligenz einsetzt und datengetriebene Geschäftsmodelle entwickelt, gestaltet zugleich die energetischen Anforderungen der dahinterliegenden Infrastruktur. Nachhaltigkeit entscheidet sich daher nicht nur in der Produktion, sondern ebenso in der Art und Weise, wie Rechenleistung bereitgestellt und betrieben wird.

Effizienz in der digitalen Transformation bedeutet, Leistung und Energieeinsatz konsequent zusammenzudenken. Präzise Messtechnik schafft dafür die Grundlage: Sie macht thermische Prozesse transparent, reduziert vermeidbare Verluste und ermöglicht eine ressourcenschonende Nutzung von Energie – bis hin zur sinnvollen Einbindung von Abwärme in lokale Wärmesysteme. Darüber hinaus kann Messtechnik auch zur transparenten Erfassung von CO2-Emissionen beitragen, etwa durch Gasanalyselösungen zur kontinuierlichen Emissionsmessung. Die so gewonnenen Daten schaffen eine belastbare Grundlage für Nachhaltigkeitsberichte und erleichtern die Kommunikation mit Kommunen und Öffentlichkeit über die tatsächlichen Umweltauswirkungen des Rechenzentrumsbetriebs. So wird aus der notwendigen Kühlung kein reiner Kostenfaktor, sondern ein steuerbarer Bestandteil nachhaltiger Wertschöpfung.