Ein Prompt hinein, eine flüssige Antwort zurück – und das in Sekundenschnelle: Große Sprachmodelle (LLMs) wie ChatGPT haben die Hürden für die KI-Nutzung in Unternehmen scheinbar beseitigt. Doch genau diese niedrige Einstiegshürde verstellt häufig den Blick auf den eigentlichen Engpass. In der Praxis scheitern KI-Projekte nämlich selten an der Wahl oder Größe des KI-Modells. Sie scheitern daran, dass Unternehmen den Aufwand unterschätzen, die eigene Wissensbasis so aufzubereiten, dass Maschinen damit verlässlich arbeiten können. Der wahre Kraftakt steckt im Verstehen, Strukturieren und Kontextualisieren des Wissens einer Organisation

Vor der Antwort liegt die eigentliche Arbeit

Im Unternehmenskontext lässt sich „Trust In AI“ auf folgende konkrete Fragen herunterbrechen: Kann ich den Daten trauen, auf deren Basis die KI arbeitet? Sind sie aktuell, vollständig und fachlich konsistent? Ist nachvollziehbar, warum ein Ergebnis entsteht? Wurden die relevanten Informationen überhaupt von der KI hinzugezogen – oder nur das, was zufällig leicht verfügbar war?

Genau hier stoßen LLMs an ihre Grenzen. Sie können keine Ordnung in widersprüchliche, lückenhafte oder semantisch unscharfe Datenbestände bringen. Ihre beeindruckende Fähigkeit, plausibel zu formulieren, wird hier zum Risiko, da über mangelhaften Input hinweggeglättet werden kann. Dennoch wird KI vielerorts noch immer an der Qualität ihrer Ausgabe gemessen. Der Mehrwert – und der Aufwand – für Unternehmen entsteht jedoch dort, wo Daten qualifiziert, Kontexte aufgebaut und Wissensstrukturen gepflegt werden. Diese Vorarbeit ist entscheidend dafür, ob KI-Ergebnisse reproduzierbar, erklärbar und messbar sind.

Das ist besonders wichtig, wenn KI-Systeme skalieren sollen. Dann geht es um Konsistenz, Nachvollziehbarkeit, quantitative Auswertung und die Fähigkeit, mit großen Dokumentenmengen kontrolliert umzugehen. Genau in dieser Schnittmenge aus sprachlichen, fachlichen und quantitativen Aspekten stoßen reine LLM-Setups regelmäßig an ihre Grenzen.

AI-Ready Data ist mehr als verfügbare Daten

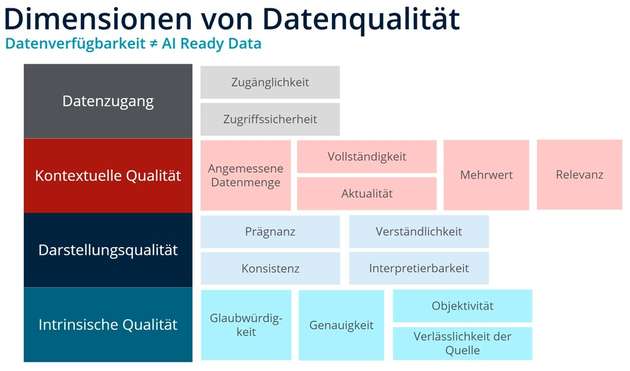

Nur weil ein Unternehmen über umfangreiche Datenbestände verfügt, sind diese nicht automatisch für KI geeignet. Wer aus unverbundenen Dokumenten, Dubletten, Freitexten und Altdaten direkt belastbare Ergebnisse erwartet, verwechselt Datenzugang mit Datenqualität. Für wiederkehrende Prozesse, automatisierte Entscheidungen oder regulatorisch sensible Kontexte ist ein robuster Rahmen erforderlich. Sind die Informationen eindeutig? Lassen sich Quellen zurückverfolgen? Gibt es Widersprüche zwischen Systemen? Fehlen entscheidende Felder? Sind die Dokumente fachlich sauber verschlagwortet? Ist erkennbar, welche Inhalte veraltet, welche gültig und welche nur lokal relevant sind?

Wenn Begriffe kippen, kippt die KI

Hinzu kommt, dass Dokumentenbestände in Unternehmen zumeist historisch wachsen. Begriffe wandern dabei zwischen Abteilungen, Systemen und Dateiformaten. Dasselbe Wort kann im Baukontext etwas anderes meinen als in der Versicherungsbranche oder in der technischen Dokumentation. Menschen macht das nichts aus, weil sie „ihre“ Domäne kennen. Für KI ist es jedoch ein Problem der Semantik.

Damit ein System fachlich belastbar arbeitet, reichen Rohdaten folglich nicht aus. Benötigt werden Metadaten, Glossare, Referenzstrukturen und semantische Einordnungen, die deutlich machen, was ein Begriff im jeweiligen Kontext tatsächlich bedeutet. Erst dadurch entsteht ein Arbeitskontext, in dem „richtig“ mehr bedeutet als sprachlich plausibel oder statistisch wahrscheinlich.

Fachwissen liegt oft dort, wo keine Maschine es sieht

Was aber, wenn das relevante Wissen gar nicht in Datenform vorliegt? Ein nicht zu unterschätzender Teil des Wissensschatzes von Unternehmen steckt in Routinen, Ausnahmen, impliziten Regeln und dem Erfahrungswissen der Fachbereiche. Die Mitarbeitenden wissen beispielsweise, welche Quelle verlässlich ist, welcher Wert formal korrekt, aber praktisch irrelevant bleibt oder welche Formulierung intern eine besondere Bedeutung trägt. Dieses Wissen wurde oft nie sauber dokumentiert, da es im Arbeitsalltag unter Menschen stillschweigend funktioniert.

KI hingegen lebt von expliziten Signalen. Sie muss lernen, wie eine Organisation ihre Sprache verwendet, welche Kategorien üblich sind und welche Abweichungen geschäftskritisch werden können. Genau deshalb greift „Human in the Loop“ zu kurz, wenn Fachabteilungen erst am Ende die Ergebnisse der KI prüfen. Sie müssen bereits früher hinzugezogen werden: bei der Klärung von Begriffen, bei der Beschreibung von Regeln, bei der Bewertung von Quellen und bei der Frage, welche Kontexte für eine belastbare Antwort zwingend dazugehören. Der schwierige Teil vieler KI-Vorhaben besteht darin, dass Experten erklären müssen, wie sie denken. Das ist aufwendig. Es ist aber oft die Voraussetzung dafür, dass aus einem sprachgewandten System ein fachlich nutzbares wird.

Unabhängig vom gewählten LLM kann KI verdichten, strukturieren, vorbereiten, vergleichen und beschleunigen. Sie kann große Mengen an Informationen durchdringen und Fachleuten Arbeit abnehmen, die bislang Zeit, Aufmerksamkeit und Nerven kostet. Was sie nicht leisten kann: Verantwortung übernehmen, widersprüchliche Daten stillschweigend korrigieren oder den vollen Organisationskontext aus dem Stand verstehen. Der Mensch bleibt deshalb im Prozess als fachliche und organisatorische Instanz erhalten.

.jpg)