Die weltweite Datenmenge soll bis 2025 auf 163 Zettabyte steigen - das wäre das Zehnfache im Vergleich zu 2016. Das sagt eine Prognose des Marktforschungsunternehmen International Data Corporation (IDC) voraus, 2017 im Whitepaper „Data Age 2025“, veröffentlicht. Bisher stellte die größte Quelle der weltweit generierten Daten der Endverbraucher dar. 2025 sollen hingegen 60 Prozent der globalen Datenmenge von Unternehmen erzeugt werden. Die Studie zeigt: Die Big-Data-Ära ist im vollen Gange. Aus diesem Grund wird von Daten als dem Rohstoffe der Zukunft gesprochen. Auch große Industrie-

unternehmen sehen das so. BASF-Vorstandschef Martin Brudermüller sagte etwa 2017, damals noch als Vize-Vorstandschef: „Wir sitzen auf einer wahren Goldmine und wissen nicht einmal, wie viel Gold drin ist.“

Doch wie diese Goldmine nutzen? Das Schlagwort lautet Data Analytics. Auf Basis von Daten lassen sich mit Hilfe intelligenter Software relevante Sachverhalte herausarbeiten und Vorhersagen treffen. Als Ergebnis davon steigt die Effizienz und neue Geschäftsfelder entstehen. Maschinen- und Anlagenbetreiber können beispielsweise bereits pro aktiv agieren, bevor Fehler in ihren Geräten und Produktionsstätten entsteht und dadurch ungeplante Anlagenstillstände vermeiden. Datenanalyse bietet aber auch Empfehlungen zur Entscheidungsfindung.

Trotz dieser vielversprechenden Aussichten kommt Data Analytics in der Realität bisher noch recht wenig zum Einsatz. 2015 kam die Universität Potsdam in Zusammenarbeit mit dem Softwarehersteller SAS in ihrer Studie „Wettbewerbsfaktor Analytics“ zu dem Ergebnis, dass 90 Prozent der Industrieunternehmen in Deutschland, Österreich und der Schweiz weniger als die Hälfte ihrer Daten nutzen. 34 Prozent der befragten Unternehmen würden analytische Systeme in der Produktion nutzen, 40 Prozent in der Logistik. Im Qualitätsmanagement sind es nur 20 Prozent. Die internen Strukturen vieler Unternehmen, vor allem im Mittelstand, sind der Studie zufolge noch nicht für das riesige Potenzial von Big Data bereit.

Analyse nicht ohne Sensoren

Ohne die richtigen Sensoren sind alle übergeordneten Systeme zur Datenanalyse blind. Sie bilden die Schnittstelle zwischen digitaler und realer Welt. Für die Datenverarbeitung und Bereitstellung gibt es verschiedene Möglichkeiten: Die Informationen können direkt im Sensorgehäuse verarbeitet und angezeigt werden, als zweite Möglichkeit stehen externe Auswertemodule und Anlagensteuerungen zur Verfügung. Außerdem können Daten in einer Cloud analysiert werden.

Geeignete Sensoren sind allerdings teuer. Der Verband Deutscher Maschinen- und Anlagenbau (VDMA) hat deshalb dieses Jahr einen Leitfaden Sensorik für Industrie 4.0 herausgegeben. Auch das Fraunhofer-Institut IIS weiß um die Problematik. Schwierigkeiten hätten dabei vor allem kleine und mittelgroße Unternehmen. Gemeinsam mit anderen Fraunhofer-Instituten sowie dem Halbleiterhersteller Globalfoundries arbeitet es deshalb an dem Projekt „Universelle Sensor-Plattform“ (USeP). 2019 soll der Prototyp eines Sensorknotens fertig sein. Das Paket umfasst einen System-on-Chip (SoC), verschiedene Sensoren unterschiedlicher Hersteller, eine Energieversorgung, ein Radio Interface und drahtgebundene Schnittstellen, also eine Kommunikationstechnologie, die drahtlos oder über Kabel mit der Außenwelt kommuniziert.

Aber selbst der beste Sensor bringt keine Fortschritte, wenn die Daten nicht ausgewertet werden. Analysesoftware gibt es verschiedene auf dem Markt. Ein Beispiel ist Anominer von Knowtion, ein Ingenieur- und Softwaredienstleister. Der Cloud-Dienst wurde zusammen mit dem Karlsruher Institut für Technologie (KIT) entwickelt und erkennt zeitliche Veränderungen und Abweichungen vom Normverhalten.

Analytic-Tools aus der Cloud können den Einstieg in die Datenanalyse erleichtern. Microsoft Azure ist eine der großen Cloud-Computung-Plattformen neben Amazon Web Services (AWS) und Google Cloud Platform. Zusammen mit Nvidia macht Microsoft zudem Ressourcen für KI-Anwendungen über die Cloud verfügbar. Nutzer können auf HGX-1-Chassis mit acht Hochleistungs-Grafikprozessoren der Reihe Pascal 100 von Nvidia zugreifen.

Analytics „on the edge“

Viele Unternehmen betrachten die Cloud jedoch mit Skepsis. Sie fürchten um die Sicherheit ihrer Daten. Auch für Einsatzgebiete, bei denen aus der Datenanalyse direkte Handlungen abgeleitet werden, ist die Cloud ungeeignet. Sämtliche Daten, die Maschinensensoren und Produktionssystemen erzeugen, müssen dabei ohne Zeitverlust ausgewertet werden. Wichtig ist deshalb eine Analyse der Informationen vor Ort; also nah am Sensor. Kleinrechner können die Bewertung von Sensordaten direkt in der Maschine ausführen. Über eine Event Stream Processing Engine (ESP) lassen sich Daten während der Übertragung, also im Datenstrom und vor der Speicherung, analysieren. Probleme können so im Vorfeld abgewendet werden. GE Transportation analysiert etwa Sensordaten für seine rund 1.200 Lokomotiven mit SAS Event Stream Processing direkt an Bord in Echtzeit, um unter anderem den Energieverbrauch der Maschinen zu optimieren.

Bei Data Analytics müssen Unternehmen auf leistungsstarke Hardware setzen, die optimal mit der Analyse-Software zusammenarbeitet. Der Halbleiterhersteller Intel kooperiert deshalb mit mehreren Softwareanbietern. Zum Beispiel verfügen IoT-Gateways von Intel über einen Software-Stack von SAP. Zusammen mit SAS hat Intel außerdem „Analytics Fast Track for SAS“ herausgebracht. Die Hardware wird von Intel zur Verfügung gestellt, die Software von SAS ist bereits vorkonfiguriert. Hier profitieren SAS-Anwendungen von den Leistungen der Intel-Xeon-Platinum-Prozessoren.

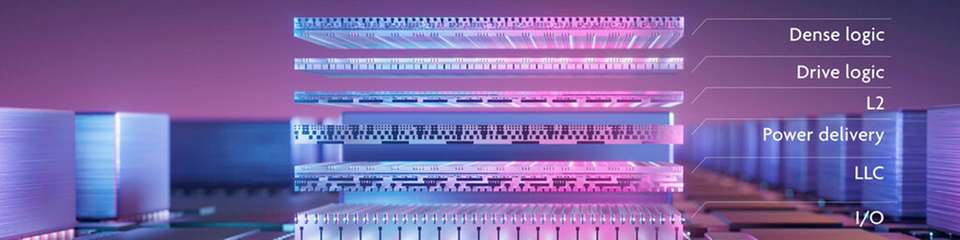

Um 163 Zettabyte Daten auszuwerten, ist eine Leistungssteigerung bei der Hardware notwendig. Xilinx hat deshalb die Produktkategorie „Adaptive Compute Acceleration Platform“ (ACAP) angekündigt. Noch dieses Jahr soll der Tape-out für 7 nm erfolgen, die Auslieferung 2019. Über 20 Mal so schnell wie der aktuelle FPGA-Chip von Xilinx soll sie beim Maschinenlernen rechnen, um den Faktor 10 bis 100 schneller als aktuelle CPUs bei Workloads arbeiten und mehr Einsatzmöglichkeiten als GPUs und ASICs bieten.

10.000 Data Scientists gesucht

Es zeigt sich: Im Bereich Data Analytics wird in den nächsten Jahren noch viel passieren. Und auch wenn die Datenanalyse für viele Unternehmen noch ein Buch mit sieben Siegeln ist: Ein neuer Beruf ist bereits entstanden - der Data Scientist. Der Stifterverband für die deutsche Wissenschaft hat für seinen Hochschulbildungsreport 2017/18 den Bedarf an Datenanalysten ermittelt. Auf Basis der Stellenangebote auf der Online-Jobbörse Stepstone rechnete der Verband hoch, dass in Deutschland rund 10.000 Spezialisten auf diesem Gebiet gesucht werden. Und das schon heute.

Die fünf Typen von Data Analytics

Descriptive Analytics ist die einfachste Form und stellt dar, was geschehen ist. Diagnostic Diagnose geht einen Schritt weiter und gibt Aufschluss darüber, was geschehen ist und weshalb. Predictive Analytics sagt voraus, was wann und warum geschehen wird. Prescriptive Analytics ist eine durch Simulationen unterstützte Analyse, die die beste Vorgehensweise vorschlägt. Cognitive Analytics stellt die komplexeste Variante dar, zu der computerbasierte simulierte Denk- und Vorgehensweisen gehören. Es beinhaltet Künstliche Intelligenz und Maschinelles Lernen.