Forscher der TU Ilmenau haben in einer Studie untersucht, wie die Wirkmechanismen, die es Menschen ermöglichen, Erlerntes im Schlaf zu vertiefen, auf künstliche neuronale Netze übertragen werden können. Ihre Ergebnisse sollen dazu beitragen, die Leistungsfähigkeit selbstlernender Maschinen drastisch zu erhöhen.

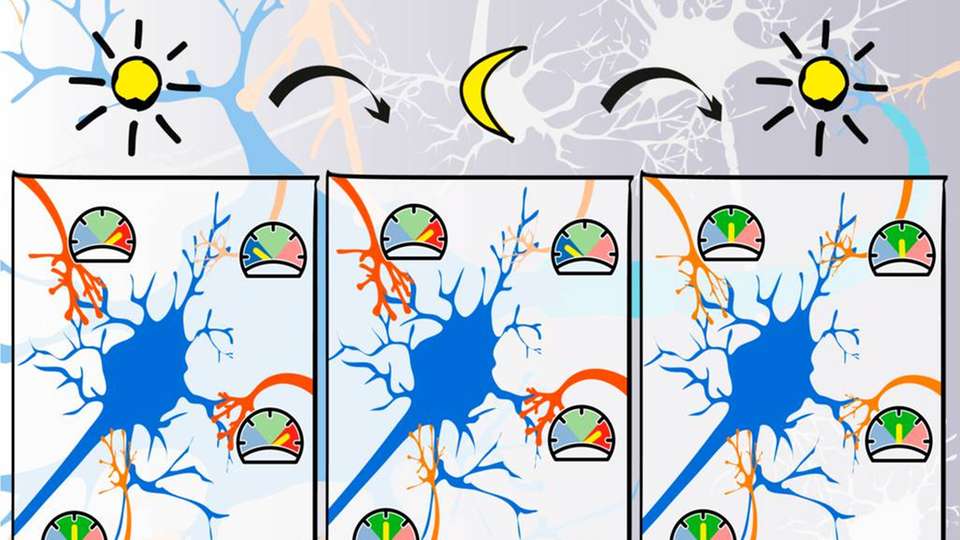

Die Erkenntnisse über das „nächtliche Lernen“ machten Schlafforscher dabei erst vor wenigen Jahren. Sie bauten auf der Beobachtung auf, dass Synapsen während Wachphasen nicht nur aktiv lernen, sondern auch chemische oder elektrische Signale von Neuronen verstärken oder reduzieren. Die Synapsen leiten also Signale nicht nur von Nervenzelle zu Nervenzelle weiter, sondern verstärken auch deren Intensität oder schwächen sie ab.

Auf diese Weise werden Neuronen in die Lage versetzt, die sich ändernden Einflüsse der Umgebung aufzunehmen und sich ihnen anzupassen. Im Schlaf normalisiert sich dieser Erregungszustand wieder, und das Nervensystem kann die in der Wachphase aufgenommenen neuen Informationen im Gedächtnis verarbeiten und durch Vergessen zufälliger oder unwichtiger Informationen verfestigen. Gleichzeitig wird es für die Aufnahme neuer Informationen empfindlicher.

Schlafvorgänge auf Maschinen übertragen

Auf diesen Vorgang, genannt synaptische Plastizität, baute der Leiter des Fachgebiets Softwaretechnik für sicherheitskritische Systeme der TU Ilmenau Prof. Patrick Mäder auf: „Die synaptische Plastizität ist für die Funktion und Leistungsfähigkeit unseres Gehirns verantwortlich und damit die Grundlage des Lernens“, sagt er. „Blieben die Synapsen immer in einem aktivierten Zustand, würde dies, wie wir aus Tierversuchen wissen, letztlich das Lernen erschweren. Erst die Erholungsphase während des Schlafs macht es möglich, dass wir das, was wir gelernt haben, im Gedächtnis behalten.“

Die Fähigkeit des synaptischen Systems, dynamisch auf unterschiedliche Reize reagieren zu können und das Nervensystem stabil zu halten, ahmen die Forscher in künstlichen neuronalen Netzwerken nach. Mithilfe der sogenannten synaptischen Skalierung übertragen sie die Mechanismen, die das Gehirn regulieren, auf Verfahren des maschinellen Lernens – mit dem Ergebnis, dass sich die künstlichen neuronalen Modelle ähnlich wirkungsvoll verhalten wie ihr natürliches Vorbild.

Selbstregulierung des Gehirns nachahmen

Ein Problem gibt es aber bei KI-Methoden, die aus der Natur entlehnt sind: die sogenannte Überanpassung. „Als Überanpassung bezeichnen wir, wenn ein Modell sich bestimmte Muster in den Trainingsdaten gemerkt hat, aber nicht flexibel genug ist, um damit korrekte Vorhersagen zu unbekannten Testdaten zu treffen“, erklärt Martin Hofmann, Doktorand von Prof. Mäder und Co-Autor der Veröffentlichung. „Wir suchen daher nach Wegen, wie sich der Überanpassung entgegenwirken lässt und wie wir stattdessen den Mechanismen der Selbstregulierung des Gehirns näherkommen können.“

Die Erkenntnisse der TU Ilmenau sollen neue Möglichkeiten beim Deep Learning eröffnen und haben laut den Forschern internationale Beachtung in der Wissenschaft gefunden. Anwendungen für Maschinen, die mit den bioinspirierten Methoden lernen, finden sich unter anderem in der Medizin, wenn etwa mithilfe von EEG- oder Tomographieuntersuchungen Krankheiten auf Basis biologischer Daten erkannt werden. Aber auch die Regelung von Smart Grids oder automatisierte Laser-Fertigung gehören zu möglichen Einsatzgebieten.